生成AIを使うなら最低限ここだけは|情報・権利・品質・責任のチェックリスト

目次

生成AIは業務効率化に非常に便利です。しかし、「情報の漏洩や権利侵害、品質低下などの事故が怖い」と、活用や導入に二の足を踏んでしまう発注者・意思決定者の方は少なくありません。特にAI活用のルールが整備されていない状態では、リスクを恐れて導入自体が進まないという課題に直面しがちです。

本記事では、制作の現場で起きる事故を前提に、生成AIを安全に使うための最低限のルールと、社内で合意できるチェック項目をまとめました。まずは全体像を把握するために、「生成AI時代のWeb支援」も併せてご覧ください。

チェックリストの全体像(最小→推奨)

ルールをもりすぎ、形骸化しててしまうことを防ぐため、まずは「今日から守るべき最小構成」を徹底し、慣れてきたら「成果を出すための推奨構成」へ段階化していくアプローチをおすすめします。

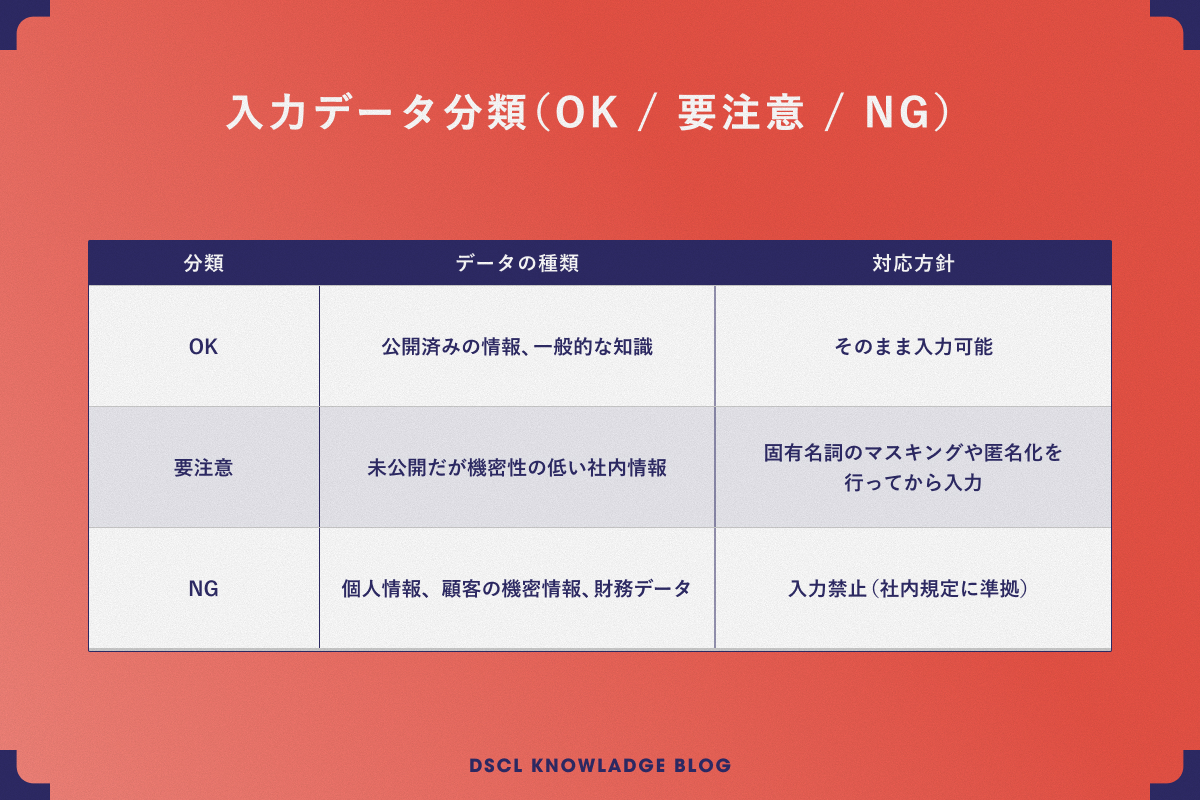

情報(機密・個人情報・学習データ)

- 何を:入力してはいけない情報(機密情報や個人情報など)を定義し、マスキングや匿名化・要約の方針を決めます。また、入力データがAIの学習に利用されないツール(オプトアウト設定等)を選定します。

- なぜ:情報漏洩の事故を防ぎ、社内規定に適合した安全な環境を構築するため。

- 誰が:発注者・意思決定者、PM

- いつ:ツールの選定時、およびプロンプト入力の直前

- アウトプット:社内規定に合わせた利用ツール一覧と入力ルール

権利(著作権・商標・引用・類似)

- 何を:生成物の取り扱い(引用・転載のルールや学習の誤解の解消)を定め、画像やコピーにおける既存作品との類似リスクを確認します。

- なぜ:悪意がなくとも、他者の著作権や商標を侵害してしまうトラブルを未然に防ぐため。

- 誰が:実務推進者(WEB担当、広報、デザイナー)

- いつ:AIでの生成直後、公開の事前確認時

- アウトプット:類似画像検索ツールやコピーチェックツールの実行結果

具体例(要注意ケース):一般的なプロンプトで画像やテキストを生成した際、意図せず既存の有名キャラクターや企業のキャッチコピーと類似した表現が出力されてしまうケースがあります。必ず公開前に類似チェックを挟むことが重要です。

品質(事実・一貫性・トーン・リスク)

- 何を:ハルシネーション(もっともらしい嘘)対策としての事実確認、ブランドトーンとの適合性、差別・偏見・誤解を招くリスクがないかをチェックします。

- なぜ:WEBサイトやコンテンツの信頼性を守り、ブランド毀損などの制作現場で起きる事故を防ぐため。

- 誰が:実務推進者(WEB担当、広報、デザイナー)、PM

- いつ:コンテンツのレビュー・推敲時

- アウトプット:事実確認(ファクトチェック)の根拠、トーンチェック結果

さらに詳しい品質担保のプロセスや基準については、「AIアウトプット品質保証」をご覧ください。

責任(誰が承認し、誰が説明するか)

- 何を:RACI(責任分界)を設計し、誰が決め、誰が作り、誰が確認し、誰が承認するのかを明確にします。また、失敗した時の“戻し方”を事前に決めておきます。

- なぜ:トラブル時の責任の所在を明確にし、迅速な対応と意思決定を行うため。

- 誰が:発注者・意思決定者、PM

- いつ:プロジェクト発足時

- アウトプット:責任分界表(RACI)とロールバック方針

検証(ユーザー/現場/指標)【推奨】

- 何を:何をもって「良い」とするかの評価基準(KPI)を定め、A / Bテストや定性テストを使い分けて効果測定を行います。

- なぜ:生成AIのアウトプットが、実際のビジネス成果にどう貢献しているかを可視化するため。

- 誰が:実務推進者、PM

- いつ:コンテンツの公開後、継続的な運用中

- アウトプット:CVR、離脱率、問い合わせ件数、自己解決率などの数値レポート

ログ(意思決定の透明性)【推奨】

- 何を:「どのプロンプトで何が出たか」だけにとどまらず、「なぜそのアウトプットを採用したか」という判断の背景を残します。

- なぜ:担当者変更時やトラブル発生時に、過去の意思決定のプロセスを透明化し、追跡可能にするため。

- 誰が:説明責任者(意思決定者)、実行責任者

- いつ:最終的なアウトプットの承認時

- アウトプット:採用理由や検討プロセスを記録したドキュメント。詳しくはデスケルメソッドカード「LOG -痕跡保存-」を参照してください。

FAQ

Q. 生成AIを使うとき、社内規程がない場合はどうすればいいですか?

まずは本記事の「最小構成(情報・権利・品質・責任)」をベースに仮のガイドラインを敷き、リスクの少ない小さな業務からテスト運用を始めることをおすすめします。

Q. AIの生成物は、どこまで人間がレビューすればいいですか?

ハルシネーション(事実誤認)や権利侵害のリスクがあるため、最終的な公開前には必ず人間によるファクトチェックとトーンの確認を行ってください。

Q. 画像生成AIはWEB制作に使っていいのでしょうか?

使用するツールが商用利用を許可しているか、学習データに権利侵害の懸念がないかを確認した上で、公開前に類似画像検索を行うなど、権利リスクに十分配慮してご活用ください。

また、クライアントが生成AIによる成果物に対するルールを設定しているケースがあります。納品物に利用するケースを含めて、契約時に確認をしておくといいでしょう。

まとめ

生成AIを現場で安全に活用するためには、まずは「情報・権利・品質・責任」の最小4カテゴリのルールを徹底することが重要です。事故のリスクをコントロールできるようになれば、次のステップとして「検証・ログ」の推奨カテゴリを取り入れ、より成果につながる運用を目指しましょう。